Lựa chọn tính năng

Tại sao lựa chọn tính năng?

Quá nhiều tính năng sẽ dẫn đến tình trạng trang bị quá mức và một số tính năng gây nhiễu.

Kỹ thuật lựa chọn đặc tính:

1. Hãy thử tất cả các kết hợp: đó cũng là kết hợp tối ưu toàn cục.

2. Thuật toán tham lam: Mọi quyết định đều dựa trên tình hình hiện tại để tìm ra giải pháp tối ưu. Quá trình tính toán: Thêm tính năng → Có tốt hơn không? → Có: Thêm vào mô hình / Không: Loại bỏ.

3. Tính đều đặn L1: hàm mục tiêu có đặc điểm mất mát: thưa thớt.

4. Cây quyết định: các nút đại diện cho từng lựa chọn tính năng. Ưu điểm: Dễ dàng xử lý dữ liệu nhiều chiều.

5. Tính toán tương quan: phương pháp phân tích trực tiếp mối tương quan giữa đặc trưng \(x_i\) và nhãn y mà không tách rời khỏi cấu trúc bên trong của mô hình. Nó chủ yếu là một phương pháp tính toán độ tương tự của vectơ.

Tóm tắt: Tất cả đều so sánh ưu nhược điểm của từng đặc điểm, phương pháp tính ưu nhược điểm cũng khác nhau.

Chính quy hóa L1

Sự đi xuống dưới độ dốc.

Vấn đề lựa chọn tính năng thường xuyên L1

Hồi quy mạng đàn hồi.

1. Tính toán:

(1) Tương quan: Tính \(x_i, y_i\) và loại bỏ những cái xấu.

(2) Thành phần chính: chỉ tính \(x_i\).

câu hỏi:

(1) Tại sao entropy thông tin được tính theo cách này?

Entropy thông tin còn được gọi là entropy chéo trong mạng nơ-ron và tất cả các bài toán phân loại nhị phân đều được tính toán theo cách này. Khi entropy chéo được dự đoán chính xác, p là 0/1. Nếu nó là 0,5 thì nó không chính xác.

(2) Tại sao thuật toán tham lam lại giảm độ phức tạp?

Giả sử rằng thuật toán tham lam được sử dụng, có năm tùy chọn ABCDE và chúng được kết hợp theo cặp. Lần đầu tiên bạn chọn D làm tổ hợp, tức là DA, DB, DC, DE và lần tiếp theo bạn chọn C làm tổ hợp, bạn chỉ cần xem xét CA, CB, CE chứ không phải CD, v.v. .

(3) Nhược điểm của việc chính quy hóa L1 là gì?

Có một số điểm bị vứt đi, vứt đi một cách ngẫu nhiên. Chúng ta hy vọng chọn được thứ tốt nhất trên toàn cầu và vứt nó đi, nhưng lại chọn thứ tốt nhất ở địa phương và vứt nó đi.

cây quyết định

Định nghĩa cây quyết định

Phân loại cây quyết định:

1. Cây quyết định phân loại/cây quyết định hồi quy.

2. Cây nhị phân/cây bội.

Thuật toán cây quyết định:

Thuật toán CART chỉ có thể xây dựng cây nhị phân, trong khi các thuật toán khác có thể xây dựng nhiều cây.

Một số chỉ có thể thực hiện hồi quy hoặc phân loại.

Ranh giới quyết định tương ứng với cây quyết định:

Cần tìm hiểu: 1. Hình dạng của cây 2. Ngưỡng của mỗi quyết định\(\theta_1\) 3. Giá trị của nút lá.

Các tính năng tốt:

Sự không chắc chắn trở nên nhỏ hơn sau khi phân loại.

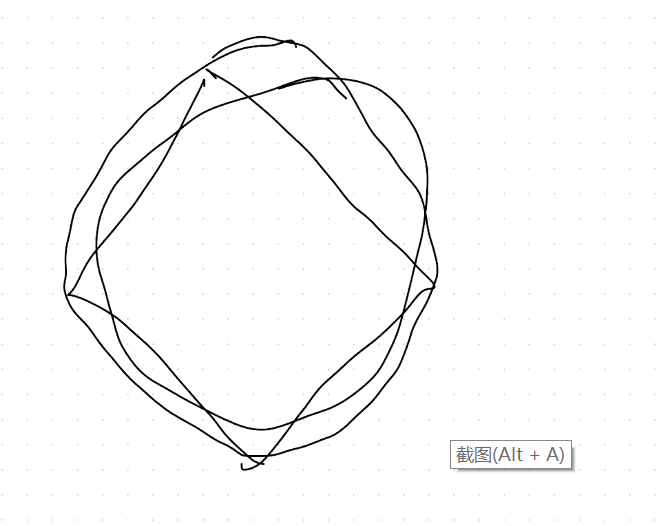

Tính không chắc chắn - entropy thông tin

Xác suất xảy ra điều gì đó là thấp: entropy thông tin cao.

Xác suất xảy ra điều gì đó rất cao: entropy thông tin thấp.

Khi nhật ký lấy 2, nội dung thông tin là bit và khi nhật ký lấy 1, đó là hiệp sĩ.

Cây quyết định: độ bất định ban đầu (trước khi chia) - độ bất định sau phép chia (sau khi chia) = giảm độ bất định (entropy thông tin - entropy có điều kiện = độ lợi thông tin).

Nút có mức tăng thông tin lớn nhất được sử dụng làm nút gốc: \(f_2>f_1\), do đó \(f_2\) được sử dụng làm nút gốc.

câu hỏi:

(1) Các nút gốc và nút lá của cây quyết định biểu thị điều gì?

Nút gốc: hướng đầu vào; nút lá: chỉ số phân biệt, là danh mục được phân loại. Nói cách khác, nút gốc là chỉ báo và nút lá cuối cùng là nhãn. Nút gốc là đầu vào và các nút lá là đầu ra.

(2) Vai trò của cây quyết định

Vai trò của cây quyết định: phân loại và hồi quy. Lưu ý: Chỉ CART mới có thể thực hiện hồi quy trên ba loại cây.

(3) Sự khác biệt giữa ranh giới quyết định của cây quyết định và ranh giới của hồi quy tuyến tính là gì?

Trước đây, ranh giới hồi quy tuyến tính đều là các loại nhị phân, nhưng bây giờ ranh giới quyết định có thể chứa nhiều loại và có thể có nhiều vùng.

(4) Tại sao entropy thông tin lại lấy logarit?

Tránh khoảng cách giữa chúng quá lớn, ví dụ: một xác suất là log0,01 và xác suất kia là log0,09.

Sự khác biệt giữa lũy thừa 0,01 và lũy thừa 0,02 ở trên sẽ rất rõ ràng và mức độ nhầm lẫn sẽ tăng lên, giúp bạn đưa ra quyết định dễ dàng hơn.

Việc xử lý dữ liệu là logarit: cốt lõi là làm cho khoảng cách lớn hơn (trong khoảng 0-1) hoặc nhỏ hơn (trên 1).

(5) Entropy thông tin có tác dụng gì?

Entropy thông tin là phép tính lượng thông tin trung bình.

Xây dựng cây quyết định

câu hỏi:

(1) Có nên xóa dữ liệu có cùng đặc điểm và nhãn khác nhau không?

Loại dữ liệu này không thể bị xóa vì loại dữ liệu này sẽ mang lại một mức độ không chắc chắn nhất định. Nếu entropy thông tin bị xóa, entropy thông tin sẽ giảm đột ngột, dẫn đến kết quả kém.

(2) Đường đi duy nhất trong cây quyết định là gì?

Hãy đưa ra một con đường và bạn có thể đi bộ đến cuối cùng.

(3) Độ sâu là gì?

Càng đưa ra nhiều phán xét, bạn sẽ càng có chiều sâu. Giá trị phán đoán tối đa là độ sâu của cây.

(4) Khi nào không cần phân loại nữa?

Nếu bạn đi đến cuối đường và toàn là F hoặc toàn N thì không cần tiếp tục phân loại.

(5) Cùng một mẫu, kết quả là cả F và N. Tình huống như thế nào?

Với cùng nhãn nhưng F và N, mẫu này nằm trên ranh giới quyết định. Chức năng của loại dữ liệu này là cho bạn biết ranh giới quyết định ở đâu. Những mẫu như vậy không thể bị xóa.

Hiệu suất cây quyết định

Hiệu suất của cây quyết định: Cải thiện hiệu suất - ngăn chặn quá mức, càng đơn giản thì càng tốt.

Làm thế nào để tránh trang bị quá nhiều cây quyết định?

Tác động của độ sâu tối đa đến độ chính xác của mô hình.

câu hỏi:

(1) Lý do cho việc trang bị quá mức cây quyết định là gì?

-

Dữ liệu không tốt: không có tính năng hữu ích nào, chẳng hạn như kết quả học tập và những gì anh ấy thường ăn.

-

Nhiễu xuất hiện trong các mẫu đặc trưng.

-

Có một lỗi về entropy thông tin ở đâu đó và lỗi ngày càng trở nên nghiêm trọng hơn khi lặp lại.

Giải pháp:

-

Cắt tỉa (sửa đổi một số nút lá).

-

Đặt độ sâu tối đa.

-

Học tập theo nhóm.

(2) So sánh nhiều lần là gì?

Lỗi sẽ xảy ra mỗi khi thực hiện so sánh. Khi độ sâu của cây lớn, nó sẽ liên quan đến quá nhiều quá trình so sánh và sẽ ngày càng có nhiều lỗi, các lỗi sẽ tích lũy và ngày càng lớn hơn.

Cách xây dựng cây hồi quy

Định lượng độ không đảm bảo trong các bài toán hồi quy: độ lệch chuẩn (phân loại là entropy thông tin).

câu hỏi:

(1) Sự khác biệt giữa cây hồi quy và cây phân loại là gì?

Phương pháp tính toán: Nút gốc của cây hồi quy được chọn theo độ lệch chuẩn và cây phân loại được chọn theo entropy thông tin. Entropy có điều kiện là như nhau.

(2) Làm thế nào để xác định nhãn trong cây hồi quy?

Cây quyết định được chia thành các nhãn giống nhau, có hoặc không. Cây hồi quy có một ngưỡng, nghĩa là nếu độ lệch chuẩn nhỏ hơn một số nhất định thì quá trình phân loại kết thúc.

Cuối cùng, bài viết về cây quyết định (ghi chú cuộc họp trong phòng thí nghiệm) kết thúc tại đây. Nếu bạn muốn biết thêm về cây quyết định (ghi chú cuộc họp trong phòng thí nghiệm), vui lòng tìm kiếm các bài viết của CFSDN hoặc tiếp tục duyệt các bài viết liên quan. tương lai! .

Tôi là một lập trình viên xuất sắc, rất giỏi!